|

人工智能圣杯虽然遥远,但这并不妨碍机器学习继续在2016年高歌猛进,其中,深度学习仍是最亮眼的明星。机器学习的重大进展离不开三个核心内容:算法(或软件)、硬件和数据。本文仅从算法(或软件)、硬件角度梳理2016年机器学习领域(主要是深度学习)主要进展。考虑到技术进步离不开研究社区的协力与开放,本文第三部分也对2016年研究社区重大事件进行了梳理。 一、算法(或软件) 能够自主学习的机器、人与机器的自然交流一直是我们追求的人工智能圣杯。2016年,GANs 以及深度强化学习取得的进展让人类距离自主学习机器又近了一步。NLP 领域里的一些重大进展,比如机器翻译,也使得人与机器的交流更加顺畅。 1、生成模型 让我们距离无监督学习圣杯又近了一步。,这要归功于生成模型的突破性研究。 生成式对抗网络早在2014年由 Ian Goodfellow 提出。2016年,GAN 开始显示出真正潜力,进展非常迅速,相继出现了条件生成对抗网络(Conditional Generative Adversarial Nets)和信息生成对抗网络(InfoGAN),深度卷积生成对抗网络(Deep Convolutional Generative Adversarial Network, DCGAN)等,更加优化的 GAN 模型已经解决了之前限制深度学习发展的一些难题。 InfoGAN 模型由 OpenAI 研究员在 8 月提出。InfoGAN 能够以无监督的方式生成包含数据集相关信息的表征。例如,当被应用于 MNIST 数据集的时候,它能够在不需要人工标记数据的情况下推断出数字的类型(1、2、3……)、生成的样本的转动(rotation)与宽度(width)。 GAN 的另一种延展是被称为 Conditional GAN 的模型。这些模型能够生成考虑了外部信息(类标签、文本、其它图像)的样本,并使用它来迫使 G 生成特定类型的输出。 DCGAN ,该网络从一个高斯分布中选取 100 个随机数作为输入(将这些输入成为代码,或隐变量,用红色表示),然后输出一张图像(在这种情况下是右侧的 64x64x3 的图像,用绿色表示)。随着代码的逐步改变,生成的图像也在改变——这说明该模型已经学会了用来描述世界的模样的特征,而不仅仅是记得某些样本。 。模型本质就是 Conditional GAN,只不过它使用了两层 Conditional GAN 模型,第一层模型 P(X1|z, c) 利用输入的文字信息 c 生成一个较低分辨率的图片。之后第二层模型 P(X|c,,X1) 基于第一层生成的图片以及文字信息生成更加优化的图片。文中给出的实验效果非常的惊人,可以生成 256x256 的非常真实的图片。 。GAN 不光自身有变种和优化,也能被其它算法融合吸收,发挥强大效果。2016 NIPS 会前几天发布的 Plug & Play Generative Networks(PPGN,即插即用生成网络)的最新进展((Nguyen et al, 2016) 就是生成模型领域 State-of-the-art 论文。 PPGN是融合了包括 GAN 在内的很多算法和技巧的新算法,整合了对抗训练、CNN 特征匹配、降噪自编码、Langevin采样等,它从 ImageNet 中生成了 227x227 的真实图片,是目前在这个数据集上跑得最惊人的一套算法。PPGN 生成的图像同类差异化大,可根据指定生成不同类别的图像、多类化,生成的图像清楚分辨率高。 。2016年9月,谷歌 DeepMind 发布博客介绍他们在文本转语音系统上取得的重大进展。DeepMind 表示,他们最新的深度生成模型 WaveNet 将机器语音合成的表现与人类之间水平的差距至少缩减了 50%,也是目前文本到语音环节最好的深度生成模型。 计算机发出声音,最常用的 TTS 方法可能是拼接式语音合成(Concatenative Synthesis),这种机械式方法使得计算机输出音频经常产生语音毛刺、语调的诡异变化、甚至结巴,无法调整语音的强调性音节或情绪。另外一种方法是参数化方法,利用数学模型对已知的声音进行排列、组装成词语或句子来重新创造音频,能让机器输出的音频听起来不那么机器化。这两种技术的共同点是简单、机械地将语音片段拼接起来,而不是从零开始创造出整个音频波形。 WaveNet 正是一种从零开始创造整个音频波形输出的技术。WaveNet 利用真实的人类声音剪辑和相应的语言、语音特征来训练其卷积神经网络(convolutional neural networks),让其能够辨别这两方面(语言和语音)的音频模式。使用中,对WaveNet 系统输入新的文本信息,也即相对应的新的语音特征,WaveNet 系统会重新生成整个原始音频波形来描述这个新的文本信息。 2016年,DeepMind 还发表了强大的图像生成模型 PixelRNN (PixelRNN 利用 RNN 建模图像像素关系,突破传统)、PixelCNN 以及视频生成模型 。 2、 强化学习和使用深度神经网络的深度学习可以很漂亮地互相补充,强化学习与深度学习结合的方法出现强劲势头。

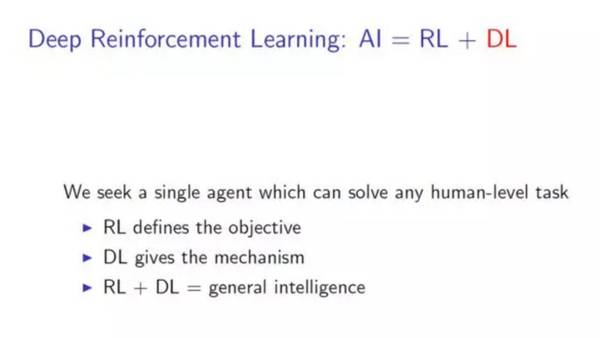

。2013年以来,DeepMind 团队相继在 NIPS 和 Nature上发表了用深度强化学习玩 Atari 游戏的论文。。一个多月后, (责任编辑:本港台直播) |